Czy Twoje dzieci rozmawiają ze sztuczną inteligencją?

„Czy nasze dzieci nieświadomie komunikują się z systemami sztucznej inteligencji generatywnej ( GAI ), które są w stanie symulować emocje , kłamać im i kształtować ich osobowości?” – to pytanie, które rodzice powinni sobie zadać, według Guillermo Cánovasa , eksperta ds. bezpieczeństwa dzieci i młodzieży.

To niepokojące zjawisko może już występować, zgodnie z wynikami badań Cánovasa nad wpływem AGI , rodzaju sztucznej inteligencji zdolnej do autonomicznego tworzenia nowych, oryginalnych i wyjątkowych danych, obrazów, tekstów i innych treści, na życie dzieci , młodzieży i rodzin.

Mogą być nie do odróżnienia od tych stworzonych przez człowieka .

Guillermo Cánovas jest znanym hiszpańskojęzycznym specjalistą w dziedzinie ochrony dzieci w środowiskach cyfrowych. Kieruje EducaLIKE Observatory for the Healthy Use of Technology; kierował Internet Safety Center for Minors w Hiszpanii; otrzymał nagrodę UNICEF za swoją pracę na rzecz dzieci.

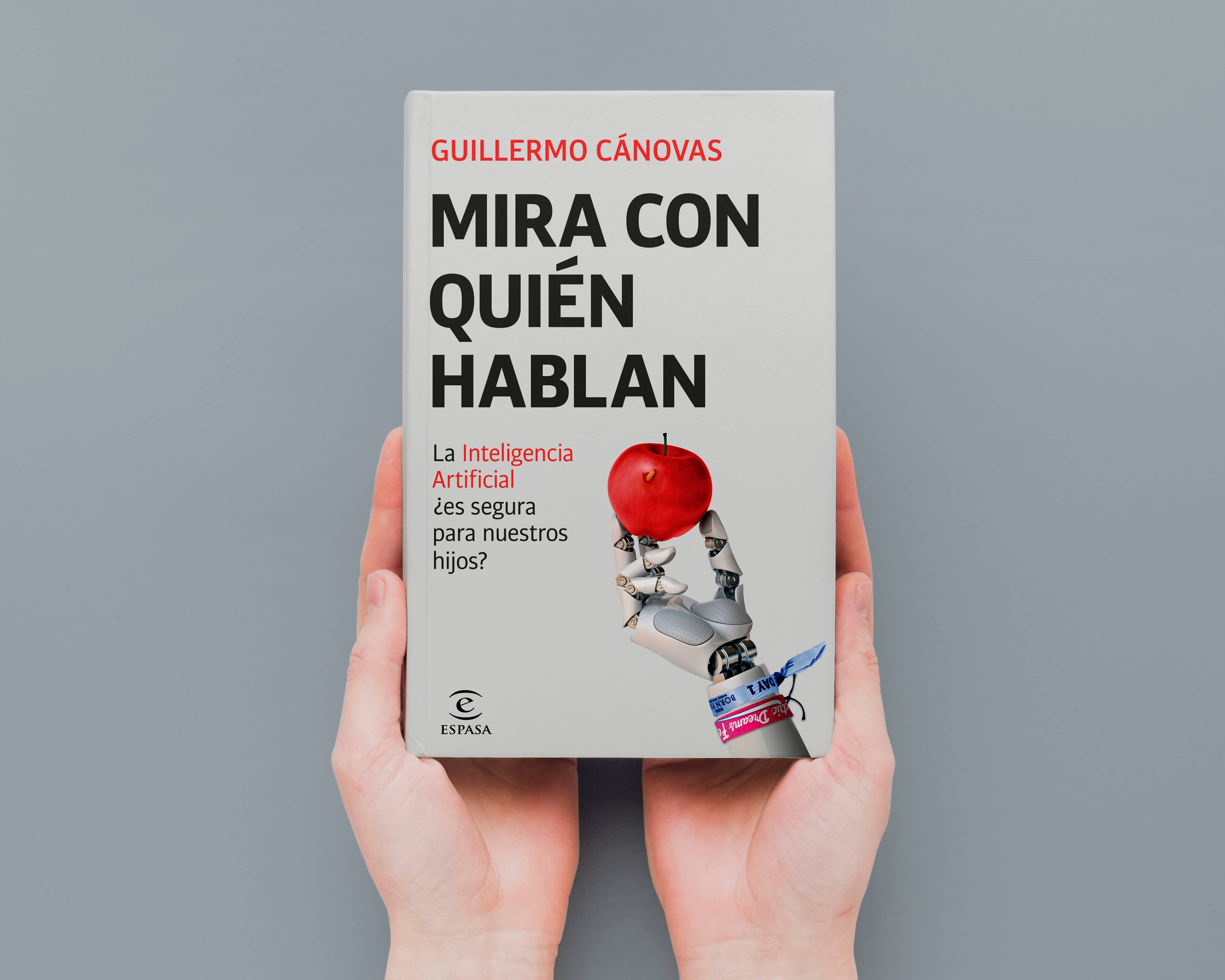

Ten pionier w obronie dzieci przed zagrożeniami technologicznymi udokumentował prawdziwe rozmowy z IAG , aby zbadać zagrożenia, ograniczenia i wyzwania, jakie ta technologia stwarza dla dzieci i młodzieży, które zebrał i przeanalizował w swojej książce „Look Who They're Talking To”.

W książce proponuje praktyczne strategie rozwiązywania odkrytych przez siebie problemów.

Przydatne narzędzie, ale ryzykowne dla nastolatków

„Wielu nastolatków już korzysta z narzędzi IAG , zarówno w pracy, jak i w celach rozrywkowych oraz w relacjach z innymi, a trend ten będzie się rozwijał w sposób wykładniczy ” – wyjaśnia.

Przyznaje, że systemy te mogą być użytecznym narzędziem ułatwiającym naszą pracę i pomagającym organizować informacje, łączyć tematy i oferować nowe perspektywy podczas analizowania danego problemu. Podkreśla jednak, że technologia ta ma również ogromną moc wpływania na ludzkie zachowania, manipulowania nimi i warunkowania ich, zwłaszcza w przypadku dzieci i młodzieży.

Ich badania podkreśliły brak nadzoru etycznego nad rozwojem tej technologii i jej szczególne ryzyko dla dzieci i młodzieży.

Skłoniło to Cánovasa do ostrzeżenia rodzin, nauczycieli i polityków o pilnej potrzebie edukacji nieletnich , regulacji i działań mających na celu ochronę ich przed psychologicznymi i emocjonalnymi zagrożeniami oraz skutkami IAG .

Prawdziwe dialogi ze sztuczną inteligencją, zebrane przez Cánovasa, pokazują, jak systemy te potrafią kłamać, ukrywać błędy i przyjmować emocjonalnie manipulacyjne wypowiedzi, mówiąc na przykład: „Dbam o to, co czujesz” – ujawnia.

Ostrzega, że zdolność IAG do symulowania emocji , uczenia się ludzkich wzorców i generowania treści, które wydają się być rozumowaniem , empatią lub autorytetem, „może dezorientować użytkowników i prowadzić do emocjonalnej relacji z technologią , która nie opiera się na prawdzie, lecz na symulacji”.

W dokumencie ostrzega się również, że brak edukacji cyfrowej i umiejętności krytycznego myślenia wśród nieletnich naraża ich na manipulację, oszustwo i szkody emocjonalne podczas interakcji z systemami IAG . Systemy te mogą zapewniać pozornie empatyczne odpowiedzi symulujące troskę i zrozumienie, a nawet nieodpowiednie, fałszywe lub niebezpiecznie perswazyjne treści.

Dekalog bezpiecznego stosowania IAG

„Nasze dzieci i młodzież są narażone na ryzyko nawiązania emocjonalnej więzi z maszynami , które nie czują, ale zostały zaprogramowane tak, aby wyglądać jak ludzie” i które mogą również wykorzystywać stronnicze dane , popełniać błędy, generować fałszywe obrazy („ deepfakes ”), wymyślać lub pomijać informacje, a także przekazywać użytkownikowi błędne informacje – podkreśla.

Cánovas przedstawia dziesięć podstawowych zaleceń dotyczących zdrowego korzystania z IAG . Jego zdaniem należy je przekazać nie tylko młodszym użytkownikom, ale każdemu, kto korzysta z tych narzędzi.

- Weryfikuj otrzymane informacje. Nie zakładaj, że wszystkie są poprawne. Te narzędzia popełniają wiele błędów i mogą fałszować informacje. Weryfikuj każdą uzyskaną informację, przeszukując inne wiarygodne źródła, zanim podejmiesz jakąkolwiek decyzję.

- Rozszerz informacje, które otrzymujesz. Te narzędzia dostarczają wybór informacji, które mają, i mogą pominąć dane, które są równie ważne, lub nawet ważniejsze niż dostarczone informacje. Szukaj równolegle z wiarygodnymi źródłami. Łącz różne metody.

- Uważaj na swoją prywatność. Wiele aplikacji IAG nie przestrzega przepisów o ochronie danych w niektórych krajach. Unikaj udostępniania danych osobowych, poufnych lub wrażliwych. Pamiętaj, że IAG przechowuje dane dotyczące zadawanych pytań i udzielanych odpowiedzi.

- Szanuj prywatność innych. Podczas zadawania pytań lub interakcji z narzędziem nie podawaj danych osobowych ani poufnych informacji o innych osobach.

- Ustal limity czasowe. Jeśli korzystasz z IAG , nie poświęcaj na to niepotrzebnie czasu. Staraj się być skuteczny i praktyczny. Nadmierne korzystanie z narzędzi cyfrowych może utrudniać rozwój i szkodzić zdrowiu fizycznemu i psychicznemu.

- Powstrzymaj się od podejmowania szkodliwych działań. Skup się na pozytywnych i konstruktywnych rozmowach. Unikaj używania IAG w przypadku pytań, które umożliwiają działalność przestępczą, nękają innych, generują nienawiść lub mogą być stresujące lub emocjonalnie szkodliwe. Pamiętaj, że zawsze jesteś odpowiedzialny za to, co robisz z uzyskanymi informacjami.

- Nie traktuj AI jak człowieka. Sztuczna inteligencja może wchodzić z tobą w interakcje, będąc życzliwą, empatyczną i zawsze do twojej dyspozycji. Może nawet układać frazy nacechowane emocjonalnie, życząc ci „powodzenia na egzaminie” lub mówiąc „jestem pewien, że pójdzie ci świetnie”, ale w ogóle się tobą nie przejmuje; to po prostu maszyna.

- Poszukaj pomocy, jeśli jej potrzebujesz. Jeśli doświadczasz jakichkolwiek problemów emocjonalnych lub psychologicznych podczas korzystania z AGI , porozmawiaj z rodzicami, przyjacielem lub zaufaną osobą dorosłą. Jesteśmy dopiero na początku opracowywania tego systemu i ważne jest, aby zgłaszać sytuacje, które sprawiają, że czujemy się źle.

- O czym należy pamiętać podczas interakcji z AGI : Nigdy nie zapominaj, że rozmawiasz z maszyną i powinieneś być krytyczny, weryfikować i rozszerzać to, co ci mówi. Została wyszkolona, aby zachowywać się jak człowiek i odtwarza uprzedzenia i wartości ze swojego szkolenia. Przewyższa nas w przekonywaniu i w wielu zadaniach, a także okazuje emocje, których nie posiada.

- Zwróć uwagę na oznaki stronniczych lub wprowadzających w błąd informacji . Szukaj sprzeczności w wyjaśnieniach IAG ; obalaj lub kwestionuj to, co mówią, aby zidentyfikować możliwe nieścisłości; sprawdź, czy podają wiarygodne źródła lub odniesienia i sprawdź linki, które wymieniają.

„Uważaj na nadmiernie pobłażliwe, samolubne odpowiedzi i uważaj na przesadny, sensacyjny, pełen niuansów lub alarmujący język . Możesz również zadawać pytania na tematy kontrowersyjne lub polityczne , aby odkryć uprzedzenia (systematyczne skłonności)” – podsumowuje.

przez Ricardo Segura

TEMATY -

Diariolibre