Sprechen Ihre Kinder mit KI?

„Sind unsere Kinder unwissentlich mit Systemen der generativen künstlichen Intelligenz ( GAI ) in Kontakt, die in der Lage sind, Emotionen zu simulieren , sie zu belügen und ihre Persönlichkeit zu formen?“, ist eine Frage, die sich Eltern laut Guillermo Cánovas , einem Experten für Kinder- und Jugendsicherheit, stellen sollten.

Dieses beunruhigende Phänomen könnte laut Cánovas‘ Forschung über die Auswirkungen von AGI auf das Leben von Kindern , Jugendlichen und Familien bereits auftreten. AGI ist eine Art künstlicher Intelligenz, die in der Lage ist, selbstständig neue, originelle und einzigartige Daten, Bilder, Texte und andere Inhalte zu erstellen.

Diese sind möglicherweise nicht von den von Menschen geschaffenen zu unterscheiden.

Guillermo Cánovas ist ein renommierter spanischsprachiger Spezialist für Kinderschutz im digitalen Umfeld. Er leitet das EducaLIKE- Observatorium für den gesunden Umgang mit Technologie und das Internet-Sicherheitszentrum für Minderjährige in Spanien. Für seine Arbeit zum Schutz von Kindern wurde er mit einem UNICEF-Preis ausgezeichnet.

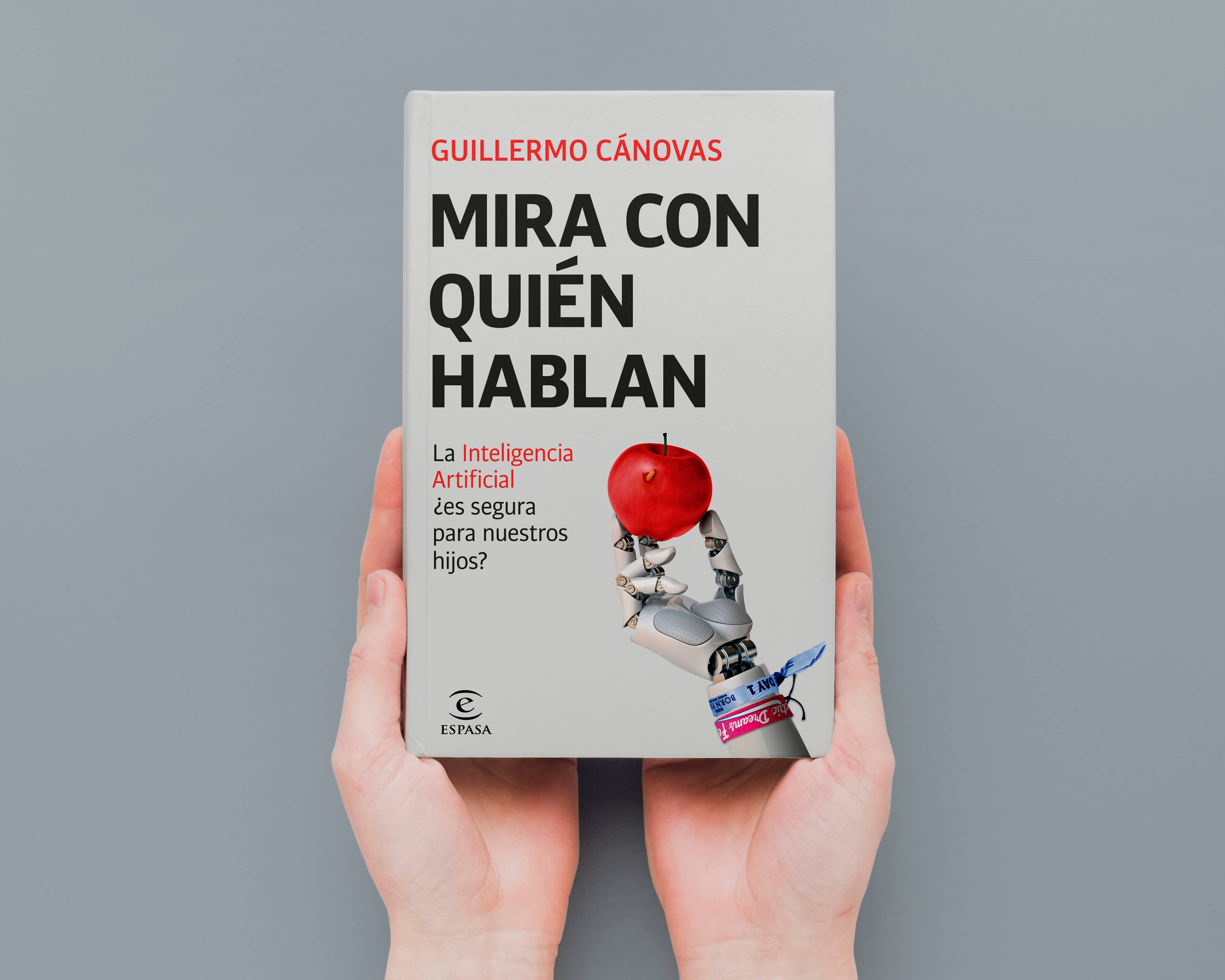

Dieser Pionier im Schutz von Kindern vor technologischen Risiken hat echte Gespräche mit der IAG dokumentiert, um die Risiken, Einschränkungen und Herausforderungen zu untersuchen, die diese Technologie für Kinder und Jugendliche mit sich bringt. Diese Gespräche fasst er in seinem Buch „Look Who They're Talking To“ zusammen und analysiert sie.

Darin schlägt er praktische Strategien zur Lösung der von ihm entdeckten Probleme vor.

Nützliches Werkzeug, aber mit Risiken für Jugendliche

„Viele Teenager nutzen bereits IAG- Tools, sowohl für ihre Arbeit als auch für ihre Freizeit und ihre Beziehungen, und dieser Trend wird exponentiell wachsen “, erklärt er.

Er räumt ein, dass diese Systeme ein nützliches Werkzeug sein können, das unsere Arbeit erleichtert und dabei hilft, Informationen zu ordnen, Themen zu verknüpfen und bei der Analyse beliebiger Probleme neue Perspektiven zu eröffnen. Er weist jedoch auch darauf hin, dass diese Technologie auch eine enorme Macht hat, das menschliche Verhalten, insbesondere das von Kindern und Jugendlichen, zu beeinflussen, zu manipulieren und zu prägen .

Ihre Forschung hat den Mangel an ethischer Kontrolle bei der Entwicklung dieser Technologie und das besondere Risiko, das für Kinder und Jugendliche besteht, die diese Technologie nutzen, hervorgehoben.

Dies hat Cánovas dazu veranlasst, Familien, Lehrer und Politiker zu warnen, dass es dringend notwendig sei , Minderjährige aufzuklären , zu regulieren und Maßnahmen zu ergreifen , um sie vor den psychologischen und emotionalen Risiken und Auswirkungen der IAG zu schützen.

Die von Cánovas gesammelten realen Dialoge mit künstlichen Intelligenzen zeigen, wie diese Systeme lügen, Fehler verbergen und emotional manipulative Diskurse annehmen können, indem sie beispielsweise sagen: „Mir ist wichtig, was du fühlst“, verrät er.

Die Fähigkeit von IAG , Emotionen zu simulieren , menschliche Muster zu erlernen und Inhalte zu generieren, die auf Vernunft, Empathie oder Autorität beruhen , „kann die Benutzer verwirren und zu einer emotionalen Beziehung zur Technologie führen, die nicht auf Wahrheit, sondern auf Simulation beruht“, warnt er.

Es wird auch davor gewarnt, dass Minderjährige aufgrund mangelnder digitaler Bildung und kritischen Denkens bei der Interaktion mit IAG- Systemen Manipulation, Täuschung und emotionalem Schaden ausgesetzt sind. Diese Systeme können scheinbar empathische Antworten liefern, die Fürsorge und Verständnis vortäuschen, oder sogar unangemessene, falsche oder gefährlich überzeugende Inhalte enthalten.

Dekalog zur sicheren Nutzung von IAG

„Unsere Kinder und Jugendlichen laufen Gefahr, eine emotionale Verbindung zu Maschinen aufzubauen, die keine Gefühle haben, aber so programmiert wurden, dass sie menschlich wirken“, und die außerdem verzerrte Daten verwenden, Fehler machen, gefälschte Bilder („ Deepfakes “) erstellen, Informationen erfinden oder weglassen sowie dem Benutzer Fehlinformationen liefern können, gibt er zu bedenken.

Cánovas bietet zehn grundlegende Empfehlungen für die gesunde Nutzung von IAG , die seiner Meinung nach nicht nur an jüngere Benutzer, sondern an jeden weitergegeben werden sollten, der diese Tools verwendet.

- Überprüfen Sie die erhaltenen Informationen. Gehen Sie nicht davon aus, dass alles korrekt ist. Diese Tools machen viele Fehler und können Informationen fälschen. Überprüfen Sie jede erhaltene Information, indem Sie andere zuverlässige Quellen durchsuchen, bevor Sie Entscheidungen treffen.

- Erweitern Sie die Informationen, die Sie erhalten. Diese Tools bieten eine Auswahl der vorhandenen Informationen und können Daten weglassen, die genauso wichtig oder sogar wichtiger sind als die bereitgestellten Informationen. Suchen Sie parallel mit zuverlässigen Quellen. Kombinieren Sie verschiedene Methoden.

- Schützen Sie Ihre Privatsphäre. Viele IAG -Apps entsprechen nicht den Datenschutzgesetzen einiger Länder. Geben Sie keine persönlichen, sensiblen oder vertraulichen Informationen weiter. Denken Sie daran, dass IAG Daten zu den gestellten Fragen und den gegebenen Antworten speichert.

- Respektieren Sie die Privatsphäre anderer. Geben Sie beim Stellen von Fragen oder bei der Nutzung des Tools keine persönlichen oder vertraulichen Informationen über andere preis.

- Setzen Sie sich Zeitlimits. Wenn Sie IAG nutzen, verschwenden Sie nicht unnötig Zeit damit. Versuchen Sie, effektiv und praktisch zu sein. Übermäßiger Gebrauch digitaler Tools kann Ihre Entwicklung behindern und sich negativ auf Ihre körperliche und geistige Gesundheit auswirken.

- Unterlassen Sie schädliche Handlungen. Konzentrieren Sie sich auf positive und konstruktive Gespräche. Nutzen Sie die IAG nicht für Fragen, die kriminelle Aktivitäten ermöglichen, andere belästigen, Hass schüren oder Stress oder emotionale Schäden verursachen könnten. Denken Sie daran, dass Sie stets für den Umgang mit den erhaltenen Informationen verantwortlich sind.

- Behandeln Sie die KI nicht wie einen Menschen. Künstliche Intelligenz kann mit Ihnen interagieren, freundlich, einfühlsam und immer für Sie da sein. Sie kann sogar emotionale Sätze formulieren, Ihnen „Viel Glück bei einer Prüfung“ wünschen oder sagen: „Ich bin sicher, Sie werden das gut schaffen“, aber Sie sind ihr völlig egal; sie ist nur eine Maschine.

- Suchen Sie Hilfe, wenn Sie sie brauchen. Sollten Sie bei der Nutzung einer AGI emotionale oder psychische Probleme haben, sprechen Sie mit Ihren Eltern, einem Freund oder einem vertrauenswürdigen Erwachsenen. Wir stehen erst am Anfang der Entwicklung dieses Systems, und es ist wichtig, Situationen zu melden, die uns ein schlechtes Gefühl geben.

- Was Sie bei der Interaktion mit der AGI beachten sollten: Vergessen Sie nie, dass Sie mit einer Maschine sprechen. Seien Sie kritisch, hinterfragen Sie und ergänzen Sie ihre Aussagen. Die Maschine wurde darauf trainiert, sich wie ein Mensch zu verhalten und reproduziert die daraus resultierenden Vorurteile und Werte. Sie übertrifft uns in der Überzeugungskraft und bei vielen Aufgaben und zeigt zudem Emotionen, die sie nicht besitzt.

- Achten Sie auf Anzeichen voreingenommener oder irreführender Informationen . Suchen Sie nach Widersprüchen in den Erklärungen der IAG . Widerlegen oder hinterfragen Sie deren Aussagen, um mögliche Unstimmigkeiten zu identifizieren. Prüfen Sie, ob zuverlässige Quellen oder Referenzen angegeben sind, und überprüfen Sie die angegebenen Links.

„Seien Sie vorsichtig bei allzu entgegenkommenden, eigennützigen Antworten und achten Sie auf übertriebene, sensationslüsterne, differenzierte oder alarmierende Sprache . Sie können auch Fragen zu kontroversen oder politischen Themen stellen, um Voreingenommenheit (systematische Neigungen) aufzudecken“, so ihr Fazit.

von Ricardo Segura

THEMEN -

Diariolibre